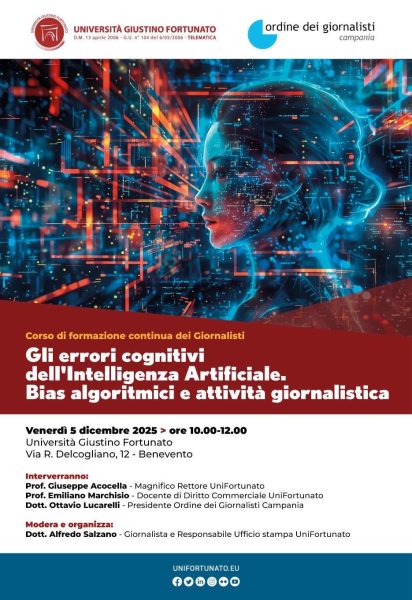

Si è svolto venerdì 5 dicembre 2025, presso l’Università Giustino Fortunato di Benevento, l’incontro dedicato a “Gli errori cognitivi dell’Intelligenza Artificiale. Bias algoritmici e attività giornalistica”, organizzato in collaborazione con l’Ordine dei Giornalisti della Campania e valido come corso di formazione continua per i professionisti dell’informazione.

L’appuntamento ha offerto ai giornalisti un’occasione di approfondimento su un tema centrale nel panorama contemporaneo: il rapporto tra Intelligenza Artificiale, distorsioni algoritmiche e qualità dell’informazione. L’attenzione si è concentrata sui limiti intrinseci dell’IA, priva di comprensione semantica e tuttavia capace di replicare e amplificare i bias cognitivi presenti nei dati con cui viene addestrata.All’incontro sono intervenuti il Prof. Giuseppe Acocella, Magnifico Rettore dell’Università Giustino Fortunato, che ha aperto i lavori sottolineando il ruolo fondamentale della formazione continua per chi opera nel mondo della comunicazione e delle politiche del lavoro, il Prof. Emiliano Marchisio, docente di Diritto Commerciale dell’UniFortunato, che ha evidenziato come l’IA non possa essere considerata realmente “intelligente”, ma piuttosto una forma di “stupidità efficiente”, capace di manipolare dati senza comprenderli. Marchisio ha inoltre analizzato i principali tipi di bias algoritmici — di funzionamento, di selezione, di retroazione e di apprezzamento/avversione — interrogandosi sul loro impatto sulla credibilità dell’informazione, il Dott. Ottavio Lucarelli, Presidente dell’Ordine dei Giornalisti della Campania, che ha richiamato i giornalisti alla responsabilità professionale e alla necessità di un uso consapevole degli strumenti digitali. A moderare e organizzare l’incontro è stato il Dott. Alfredo Salzano, giornalista e responsabile dell’Ufficio stampa dell’UniFortunato, che ha guidato la discussione mettendo in luce l’importanza di un approccio critico nell’utilizzo degli algoritmi.

Il prof. Marchisio ha sostenuto che ciò che oggi chiamiamo “intelligenza artificiale” non dovrebbe nemmeno essere definita intelligenza: si tratta piuttosto di una “stupidità efficiente”, capace di elaborare enormi quantità di dati ma priva di reale comprensione. L’IA, infatti, opera solo sul piano sintattico, non su quello semantico: manipola simboli senza comprenderli. Anche il cosiddetto test di Turing, superato da alcuni sistemi, non prova la presenza di una vera intelligenza: certifica soltanto la capacità della macchina di simulare un comportamento intelligente, non di possederlo. Così come la nostra razionalità è intrinsecamente attraversata da bias cognitivi, anche l’IA li riproduce, anzi li amplifica. Marchiosio ha distinto vari tipi di bias di funzionamento, legati al modo in cui l’algoritmo è costruito; di selezione, dovuti ai dati scelti per addestrarlo; di retroattività, che rinforzano schemi preesistenti; di apprezzamento o avversione, che orientano le valutazioni del sistema. A questo punto è stata posta la questione relativa al giornalismo: il giornalista è tenuto alla correttezza e alla verosimiglianza. L’IA può garantire verosimiglianza? Secondo Marchisio, questa domanda è mal posta, perché l’IA è programmata per funzionare in un certo modo e non può garantire autonomamente criteri etici o epistemici. La domanda davvero pertinente è un’altra: per quali scopi l’uso dell’algoritmo è consapevole? In altre parole, ciò che conta non è la “verosimiglianza” che l’IA può produrre, ma la responsabilità umana nell’impiegare gli algoritmi in modo trasparente, controllato e criticamente consapevole.